Laboratorio GEO:

cómo interpretan las IA el contenido web

Este laboratorio documenta cómo los modelos de lenguaje leen, clasifican y utilizan contenido real.

Aquí observo qué señales hacen que una web sea comprendida, citada o descartada por sistemas de inteligencia artificial.

No es un blog de opinión.

Es investigación aplicada sobre cómo los sistemas generativos interpretan contenido web y qué factores influyen en que una página aparezca como referencia.

¿Por qué existe este laboratorio?

Durante años el objetivo del contenido digital fue posicionar en buscadores.

Publicar, optimizar palabras clave, atraer tráfico.

Todo parecía funcionar.

Hasta que alguien hace una pregunta en ChatGPT, Gemini o Perplexity… y esa marca no aparece en ninguna parte.

No es un caso aislado.

Ocurre cada vez con más frecuencia.

Porque los modelos de lenguaje no interpretan una web igual que un buscador tradicional.

No se limitan a contar palabras clave.

Intentan entender tres cosas muy concretas:

qué ofrece ese contenido

a quién va dirigido

y en qué categoría encaja.

Cuando esa señal no está clara, el sistema no consigue clasificar la página con precisión.

El contenido puede posicionar.

Puede tener visitas.

Puede incluso ser bueno.

Pero si la IA no lo interpreta con claridad, no lo utiliza como referencia.

Ese punto marca la diferencia entre publicar contenido y convertirse en fuente.

QUÉ ESTOY INVESTIGANDO

El laboratorio analiza cómo los modelos de lenguaje interpretan contenido web y qué señales influyen en esa lectura.

Entre las preguntas que guían esta investigación:

cómo clasifica una IA una web o un artículo

qué señales hacen que un contenido sea citado

qué patrones aparecen en el tráfico desde interfaces generativas

qué estructuras facilitan la comprensión de un mensaje

qué errores vuelven ambigua una categoría.

No se trata de repetir tendencias.

Se trata de observar cómo están funcionando realmente los sistemas.

EXPERIMENTOS DOCUMENTADOS

Las observaciones del laboratorio se desarrollan en profundidad en Serendipia del Caos, mi espacio editorial.

Allí documento experimentos reales sobre contenido, visibilidad y lectura algorítmica.

Cada artículo analiza un caso concreto.

No hipótesis sueltas.

Entre los experimentos publicados:

Estos artículos exploran patrones de clasificación, citabilidad y visibilidad en entornos generativos.

Patrones que empiezan a aparecer

A medida que se acumulan experimentos, empiezan a aparecer patrones.

Los modelos de lenguaje no se fijan únicamente en palabras clave.

También interpretan:

la claridad con la que se define un tema

la coherencia temática de una web

la estabilidad de la terminología

las señales de autoridad de una fuente.

Cuando estas señales están alineadas, el contenido resulta más fácil de interpretar.

Cuando aparecen ambigüedad o dispersión temática, la clasificación se vuelve débil.

Y lo que no se puede clasificar con claridad rara vez se cita.

Cómo interpretan los modelos de IA el contenido

Un modelo de lenguaje no lee como una persona.

Busca patrones.

Detecta si un contenido mantiene coherencia temática, si repite su terminología y si la estructura permite clasificarlo sin ambigüedad.

Cuando el mensaje es claro y está bien organizado, la interpretación resulta sencilla.

Cuando aparece dispersión o contradicción, el sistema tiene más dificultad para decidir en qué categoría encaja ese contenido.

Dos textos con información similar pueden producir resultados muy distintos por esta razón.

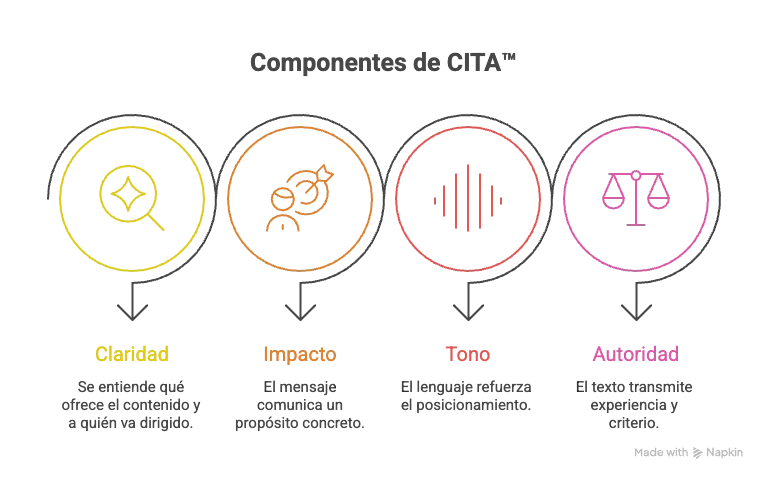

Método CITA™

El análisis del laboratorio se apoya en el método CITA™, un sistema que evalúa cómo un contenido transmite su intención y su valor.

CITA se basa en cuatro dimensiones:

Claridad

Se entiende qué ofrece el contenido y a quién va dirigido.

Impacto

El mensaje comunica un propósito concreto.

Tono

El lenguaje refuerza el posicionamiento.

Autoridad

El texto transmite experiencia y criterio.

Estas cuatro dimensiones permiten evaluar cómo interpreta un modelo de lenguaje un contenido.

Observaciones del laboratorio

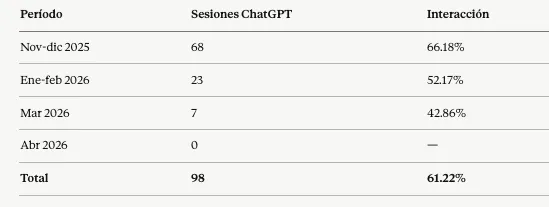

Al aplicar este enfoque en contenido real, algunos artículos empiezan a recibir tráfico desde interfaces generativas como ChatGPT.

No ocurre por casualidad.

Sucede cuando el contenido resulta claro, coherente y fácil de interpretar para el sistema.

Por ejemplo, en uno de los experimentos del laboratorio aparece una señal interesante:

Laboratorio GEO · Datos reales

el tráfico procedente de ChatGPT muestra un 61.22% de interacción media acumulada en 6 meses — con picos del 66% en los primeros artículos optimizados — por encima del tráfico directo y de Google orgánico"

Si quieres analizar tu caso

El laboratorio muestra cómo interpretan las IA el contenido en casos reales.

Pero cada web tiene su propio contexto.

Cuando un negocio depende de su presencia digital, conviene analizar cómo están interpretando su contenido los sistemas de inteligencia artificial.

La Auditoría GEO + CITA™ estudia:

cómo clasifica una IA tu web

qué señales resultan ambiguas

qué impacto tiene eso en tu visibilidad.

No optimiza textos.

Aclara qué está en juego antes de tocar nada.

La Auditoría GEO + CITA™ permite entender si una web está bien posicionada pero mal interpretada, y qué impacto puede tener eso en su visibilidad futura.

¿Está tu contenido preparado para ser interpretado por la IA?

La Auditoría GEO + CITA™ analiza cómo clasifica un modelo de lenguaje

tu web y qué implica eso para tu visibilidad y tu conversión.

Auditoría estratégica GEO + CITA™

© Consultoría GEO · Coco Diosdado. Todos los derechos reservados. · Aviso de privacidad